Anthropic이 국방 계약에서 ‘모든 합법적 사용’을 요구하는 트럼프 행정부와 충돌한 사건을 통해, 기술 정책·AI 안전·권위주의의 가치체계가 어떻게 맞물리는지 살펴본다.

이건 기술 정책과 AI 안전 분야에겐 정말 난리 같은 주말이었다. 나는 글을 쓰는 사람이긴 해도 보통은 뉴스 담당이 아닌데, 이번 순간은 AI 산업과 트럼프 행정부 특유의 유치한 권위주의가 한데 응축된 완벽한 축소판처럼 느껴졌다.

AI 회사 Anthropic—공학 중심 챗봇 Claude 로 알려진—은 OpenAI의 전 직원들이 OpenAI의 안전 기준에 만족하지 못해 나와 새로 만든 회사다. 윤리와 배려를 우선시한 Anthropic의 접근은 그들에게 족쇄가 되지 않았다. 오히려 오늘날 시장에서 최고의 LLM 제품인 Claude로 이어졌다. 2025년 7월 Anthropic은 국방부와 2년 2억 달러 규모의 계약을 수주해 기밀 정부 환경에서 사용할 AI를 지원하게 되었는데, 이는 정부가 다른 회사들과 맺었던 유사 계약을 반영한 것이었다. ChatGPT와 Llama와의 내부 경쟁에도 불구하고, Claude는 가장 품질이 높은 제품이었고 기밀 군사 시스템에서 사용 승인을 받은 유일한 제품이었다.

하지만 (상대적으로) 기업 책임을 중시하는 Anthropic의 문화는 트럼프 진영이 이미 스스로 흥분 상태로 몰아넣어 둔 광풍, 즉 “깨어 있는(woke) AI”라는 유령의 표적이 되기 쉬웠다. 대통령 행정명령 “연방정부에서 ‘Woke AI’ 방지(2025년 7월)”는 트럼프식 행정명령의 전형적인 이념적 악담으로, “DEI”, “교차성(intersectionality)”, “트랜스젠더리즘(transgenderism)” 같은 “개념을 포함”하는 것을 이유로 연방 업무흐름에 관여하는 LLM을 금지해야 한다는 거짓되고 어리석은 주장들로 가득했다.

2026년 1월, 이 명분은 자칭 “전쟁장관(secretary of war)” 피트 헤그세스(Pete Hegseth)에 의해 계승되었다. 그는 스스로 붙인 가짜이면서도 더 악랄한 직함을 썼는데, 내가 사람들에게 나를 “Dr. Destructo”라고 부르라고 강요하는 것과 비슷한 수준이다. 그는 일론 머스크의 소개로 SpaceX에서 한 연설에서, AI는 우익 이념 정렬이 필요하다는 머스크의 논지를 되풀이했다.

전쟁장관 피트 헤그세스의 SpaceX 연설 오늘 저는 전쟁부(Department of War)에서 책임 있는 AI가 무엇을 의미하는지 분명히 하고자 합니다. 기술의 활용을 제약하고 혼란스럽게 만드는 공정 AI 및 기타 DEI·사회정의 주입은 이제 끝났습니다. 즉시 효력이 발생하며, 전쟁부에서 책임 있는 AI란 부서 활동을 규율하는 법의 테두리 안에서, 안전하게 운용되는 객관적으로 진실한 AI 역량을 뜻합니다. 우리는 당신이 전쟁을 싸우지 못하게 하는 AI 모델을 쓰지 않을 것입니다.

우리는 AI 모델을 이 기준 하나로만 평가할 것입니다. 사실에 부합하고, 임무와 관련이 있으며, 합법적 군사 적용을 제한하는 이념적 제약이 없어야 합니다. 전쟁부 AI는 woke가 아닐 것입니다. 우리를 위해 작동할 것입니다. 우리는 아이비리그 교수 휴게실용 챗봇이 아니라, 전쟁 준비가 된 무기와 체계를 만들고 있습니다.

피트 헤그세스의 “미국의 군사 AI 우위 가속화” 메모는 MAGA 이상과 충돌하는 기술에 대한 이 선제전, “마치 우리가 전쟁 중인 것처럼”을 더 밀어붙였다.

DoW에서의 ‘책임 있는 AI’ 명확화 — 유토피아적 이상주의는 퇴출, 냉혹한 현실주의는 도입. 다양성·형평성·포용 및 사회 이념은 DoW에 설 자리가 없으므로, 우리는 사용자 프롬프트에 대해 객관적으로 진실한 응답을 제공하는 능력을 방해하는 이념적 “튜닝”을 포함하는 AI 모델을 고용해서는 안 된다. 또한 부서는 합법적 군사 적용을 제한할 수 있는 사용 정책 제약이 없는 모델을 활용해야 한다. 따라서 나는 CDAO가 90일 내에 모델 객관성 벤치마크를 주요 조달 기준으로 설정할 것을 지시하며, 전쟁부 조달·유지 담당 차관에게 180일 내 AI 서비스 조달을 통해 체결되는 모든 DoW 계약에 표준 “모든 합법적 사용(any lawful use)” 문구를 포함하도록 지시한다.

기존 계약에 “모든 합법적 사용”을 허용하는 새로운 문구를 넣으라는 요구는, 피트가 싸움을 걸기 시작했다는 뜻이다. DoD는 이를 소급 적용하려 했고, 즉 모든 기존 AI 계약을 업데이트해 정부가 계약과 약관에서 합의한 범위가 아니라 “모든 합법적 사용”을 위해 소프트웨어를 사용할 권한을 확장해야 한다는 의미였다. 하지만 이는 명백히 성립하지 않는다. 기존 2년 계약은 현재 문구로 이미 양측이 승인한 것이기 때문이다. (“모든 합법적 사용”이 표준 조항이라는 말도 사실이 아니다. 트럼프 행정부는 2025년에 이미 그 조항을 쓰지 않기로 선택했다.) 현재 존재하는 모든 계약의 모든 조건은 정부와 기업이 충분히 인지한 상태에서 합의한 조건들이다. 펜타곤은 기존 계약이 자신들의 손을 묶어 중요하다고 보는 어떤 일을 막는다고 이미 동의했다.

이는 정상적인 상황이며, 계약이 존재하는 이유인 안정성을 양측에 제공한다. 기업이 갑자기 “발판을 빼고” 접근 조건을 바꿀 여지도 없지만, 정부 또한 일방적으로 합의를 변경할 여지는 없다. 원래 계약을 깨고 조건을 일방적으로 바꾸려는 쪽은 Anthropic이 아니라 펜타곤이다. 그러니 이제 재협상을 해야 하고, 그렇지 않다면 펜타곤은 자신들이 맺어놓은 합의에서 빠져나갈 구실이 필요해진다.

그리고 Anthropic은 특정한 범위를 가진 프로젝트로서 Claude를 DoD에 제공해왔다. 정부 사용에도 여전히 적용되던 Anthropic의 Acceptable Use Policy 상 두 가지 핵심 “레드라인” 요구사항은, Claude가 대규모 국내 감시(mass domestic surveillance)에 사용될 수 없고 완전 자율 무기 체계(fully autonomous weapons system)의 일부로 사용될 수 없다는 것이었다.

Anthropic, 전쟁부와의 논의에 대한 다리오 아모데이(Dario Amodei) 성명(2026년 2월 26일) …좁은 일부 경우에 우리는 AI가 민주적 가치를 방어하기보다 오히려 약화시킬 수 있다고 믿습니다. 또한 일부 사용은 오늘날 기술이 안전하고 신뢰할 수 있게 수행할 수 있는 범위를 단순히 벗어납니다. 이러한 두 가지 사용 사례는 전쟁부와의 계약에 포함된 적이 없으며, 지금도 포함되어서는 안 된다고 믿습니다:

- 대규모 국내 감시. 우리는 합법적인 해외 정보 및 방첩 임무에서 AI 사용을 지지합니다. 그러나 이러한 시스템을 대규모 국내 감시에 사용하는 것은 민주적 가치와 양립할 수 없습니다. AI 기반 대규모 감시는 우리의 근본적 자유에 심각하고 새로운 위험을 제기합니다. …

- 완전 자율 무기. … 이는 오늘날 존재하지 않는 적절한 안전장치와 함께 배치되어야 합니다.

우리의 이해로는, 이 두 가지 예외는 현재까지 우리 군 내에서 모델 채택과 사용을 가속하는 데 장애가 되지 않았습니다.

Claude는 파놉티콘을 위한 것이 아니고, 킬봇을 위한 것도 아니다. 만약 그들이 그런 것을 원했다면, 다른 무언가여야 한다. AUP가 가능한 모든 악용을 금지하는 것은 아니지만, AI 기술이 그럴듯하게 남용될 수 있는 합리적인 근미래 위험 영역을 이 두 가지로 차단해 둔다. 그런데 이제 펜타곤은 계약 문구에서 이런 극도로 기본적인 안전 가드레일 없이 시스템에 접근할 수 있어야 한다고 갑자기 요구한다.

이 이야기에서 Anthropic은 방 안에서 가장 책임감 있는 사람으로서 영웅 역할을 하고 있지만, 그렇다고 내가 Anthropic을 내 ‘최애 팀’으로 응원하러 여기 있는 건 아니다. 그들은 여전히 이윤 추구 기업이고, 여전히 AI 문제에 기여하고 있으며, 심지어 트럼프 행정부의 방산 계약자가 되기로 선택하기도 했다. 그래도 동종 업계보다 더 책임감 있게 행동해왔다.

내가 가장 화나는 건, 원칙이 없으면서 권력을 얻기 위해 필요하면 무엇이든 말하고, 그 정당화가 서로 모순되어도 상관하지 않는 사람들이다. 그와 대비되게, Anthropic은 일관되게 AI 규제를 지지해왔다. 2025년 그들은 SB 53 AI 규제 법안을 지지한 첫 기술 기업이었는데, 이는 그들 자신을 포함한 기업들에게 추가 안전 요건을 의무화하는 법안이었다. 그들은 권력을 움켜쥐려는 용병이 아니다. 정부가 그들로부터 권한을 가져가게 되는 경우에도, 비즈니스 전략으로서 전반적으로 안전과 규제를 지지한다.

감시와 킬봇만이 남은 쟁점이라는 사실은, Anthropic이 정부와 맺은 조건이 실제로 얼마나 최소한이었는지를 보여준다. 그들은 군과 일하기 위해 이미 윤리적 원칙을 크게 타협했다. 그리고 나는 이를 ‘연좌제’ 같은 의미로 말하는 게 아니라, 말 그대로 Anthropic이 정부가 거의 원하는 모든 것을 할 수 있도록 허용하기 위해 정책을 특별히 수정했다는 뜻이다—상업용 제공에서는 허용되지 않는 수준으로.

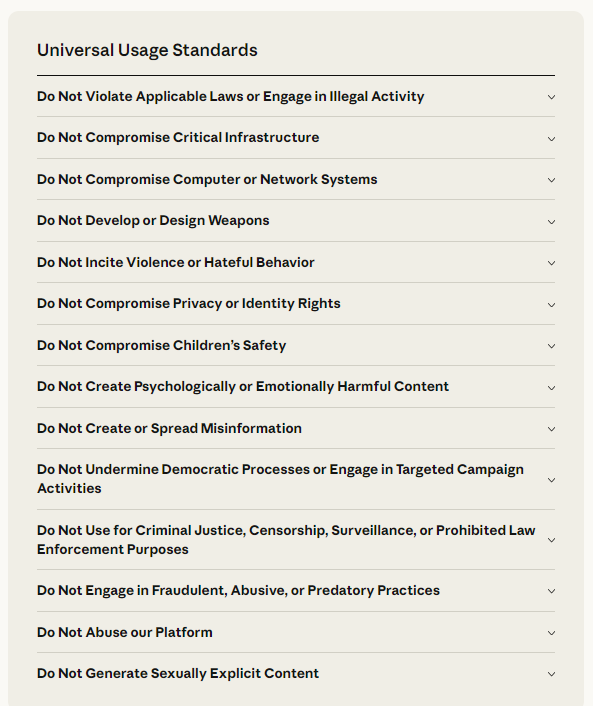

공개 Acceptable Use Policy의 “Universal Usage Standards” 아래에서 Anthropic은 무기 개발·설계를 포괄적으로 금지한다. 사실 그들의 Universal Usage Standards 대부분은 2026년 연방정부가 무엇을 의미하는지에 대한 설명처럼 보인다.

이 supposedly 보편적인 금지들은 미군에는 적용되지 않는다. Anthropic은 자율 드론 스웜을 조율하는 데 Claude를 사용하자는 제안을 제출했다. 그들의 유일한 요구는 살상 결정에 인간이 루프 안에 있어야 한다는 것뿐이었다—불량 정부에 무기를 팔면서도 안전을 향한 최소한의 제스처만을 취한 셈이다.

Anthropic은 Claude의 설계와 튜닝에 극도로 집중해왔고, 이는 Claude가 어떤 성격을 갖길 원하는지 상세히 적은 헌법(Constitution)에서 드러난다. 그들은 단지 서비스 약관으로 법률 게임을 하려는 게 아니라, 구조적 수준에서 특정 사용 범주에 저항하는 무언가를 만들려 한다. 하지만 계약이나 약관을 통해 법적 권한을 행사하는 측면에서는, 그들은 최소한만 하고 있다.

여기서 Anthropic의 명백한 실패는 애초에 방산 산업에 발을 들였다는 점이다. 최초 계약 이후 Claude는 가장 민감하고 논쟁적인 군사 작전에 크게 기여해왔다. Claude가 핵심 역할을 했다고 전해지는 니콜라스 마두로(Nicolás Maduro)의 사법외 체포가 있었고, 트럼프가 이란을 공격했을 때도 다시 사용되었다.

Anthropic CEO 다리오 아모데이는 AI 오용 가능성에 대해 지속적인 우려를 표해왔고, 미네소타에서의 연방 군사 개입이 그의 윤리 프레임워크 핵심 가치와 원칙(즉 반(反)전제)이 위험에 처해 있다는 증거라고까지 언급했다.

저는 이 에세이를 한동안 써왔고, 주로 AI와 미래에 관한 글입니다. 하지만 미네소타에서 우리가 보고 있는 공포를 고려하면, 국내에서 민주적 가치와 권리를 보존하는 것의 중요성을 강조하는 부분이 특히 관련이 있습니다.

군사 위반의 위협이 Anthropic을 걱정하게 만드는 이유는 그들이 깨어 있는 리버럴이거나 반전 히피라서가 아니라, 그들이 정상적인 사람들이기 때문이다. 그리고 2차 사고를 하는 정상적인 사람들은 미국 및 국제법의 다중 위반으로 보이는 일들에 관여하는 것이 어떤 함의를 갖는지 이해한다. 트럼프는 지금은 빠져나가고 있지만, 얼마나 오래 갈까? 그리고 그와 함께 어떤 전쟁광들이 책임을 지게 될까? 방산 계약자에게조차, 책임 있게 행동하는 건 장기전에서 중요한 플레이 방식이다.

AI를 이용한 감시의 무기화가 초래할 임박한 위협을 생각해보는 것은 흥미롭다. 대규모 감시는 매우 현실적이고 매우 심각한 문제다. 완전 자율 살상 로봇은 덜 임박한 위협이지만, 드론 전쟁을 고려하면 여전히 심각하다.

그래서 여기서 이런 이야기를 쉽게 떠올릴 수 있다. 가드레일이 두 개 있고, 그 가드레일에 의해 ‘보호받는’ 사람들이 갑자기 몹시 화가 났으니, 그들은 그 특정 규칙들을 깨고 싶어 하는 게 틀림없다. 사람들이 어떤 법이나 규제를 폐지하기 위해 갑자기 막대한 자원을 쏟아붓기 시작할 때는 대개 그 지점에 마찰이 있기 때문이다.

정상인: “AI가 대체 어떻게 사람을 죽일 수 있어요?”

유드코프스키: [기만과 도구적 수렴에 대한 복잡한 설명.]

헤그세스: “우리가 기업들에게 감독 없는 살인 로봇을 만들게 강요할 거니까요. 그게 이유죠.”

나는 이것이 상황을 가장 잘 짚는 해석이라고 생각하지 않는다. 문제는 훨씬 더 깊고 훨씬 더 나쁘다고 본다.

나는 이 갈등이 특정 조항이나 조건 하나를 둘러싼 것이라고 믿지 않는다. 트럼프 행정부가 지금 당장 그 조건을 깨고 싶어서 생긴 것이 아니라, 그들은 엄밀히 권위주의적이지 않은 관계에서 누구와도 일하는 것 자체를 거부하기 때문이다.

권위주의에는—비록 심각하게 뒤틀렸지만—내부 가치 체계가 있다. 그것은 권력, 충성, 권위의 서열에 도덕적 무게를 둔다. Anthropic은 책임감의 가장 얇은 겉치레만을 보이고 있지만, 이 작은 진정한 미덕의 제스처조차 트럼프와 헤그세스에게는 그들의 가치에 대한 실제적인 위반이기에 불쾌하다. Anthropic의 인간성에 대한 토큰 제스처가 인간혐오자들을 불편하게 만든다.

트럼프와 헤그세스는 그들의 순간순간의 변덕보다 더 높은 권위가 존재할 수 있다는 생각에 진짜 도덕적 분노를 표출한다. 권리를 가진 사람들이 서로 협력한다는 발상은, 권리 체계—사람의 가치가 ‘윗사람’이 내려주는 것이 아닌 세계—를 함의하기 때문에 불쾌하다. 이 사람들은 어떤 역량에서도 타인과 일해야 한다는 생각 자체에 분노한다. 오직 부하에게 ‘서비스받는’ 방식 말고는 말이다.

트럼프 행정부는 맹목적 충성의 컬트로 정의된다. 그들은 경제적 번영이나 기술적 효율을 위해 민간기업과 거래하려는 게 아니라, 기술 기업들을 트럼프의 파시스트 정치 프로젝트와의 동맹으로 강제로 밀어 넣으려 한다. 그리고 그들은 미국이 내전에 돌입했다고 본다. 민주당을 상대로, 민주적 도시들을 상대로, 이민자를 상대로, Antifa를 상대로, 리브들을 상대로, woke를 상대로. 그들에게 분쟁은 비즈니스 문제가 아니라, 다른 이들이 지켜야 한다고 기대되는 전시의 충성 맹세를 배반한 것이며, 그렇지 않으면 적으로 분류된다.

권위주의자들은 근본적으로 상호 이익이 되는 합의를 이해하지 못하고, 공정한 경쟁이라는 감각도 없다. 그들은 세상을 제로섬 게임으로 보며, 이기지 못하면 지는 것뿐이다. 그들 위에 어떤 힘도 있을 수 없기에, 법이나 계약에 의해 의미 있게 구속된다는 것은 심각한 모욕이다. 그들은 법을 “정책”으로 대체한다. 감독, 책임, 구제 수단 없이 강력한 행정부가 일방적으로 지시하는 “정책” 말이다. (그리고 투사는 여기서도 명백하다. 그들은 적의 “정책”을 자신들의 경우처럼 변덕과 동의어로 해석한다.)

현실 세계에서, 사용 범위(scope-of-use) 조항이 포함된 정부와의 거래는 완전히 정상이다. 미네소타에서의 무력 사용에 우려를 갖는 것은 모든 책임 있는 시민의 의무다. 하지만 권위주의의 성장은, 사람들에게 정상 범위를 벗어나 행동하라고 요구하고 점점 더 큰 요구를 들이미는 데서 드러난다.

트럼프 행정부가 폭력적으로 거부하는 것은 기술 정책이 아니라, 더 높은 기준이라는 것이 존재할 수 있다는 발상 그 자체다. 사람도, 국가도, 계약도, 법도, 윤리도, 신도 아니다. 이들은 스스로를 신으로 보는 사람들이며, 그 눈에는 미국 정부에 견제와 균형을 생각하는 것 자체가 “신 콤플렉스”다. 이는 오늘 당장 Claude를 킬봇에 넣고 싶어 한다거나, 윈터 솔저처럼 정치적 반체제 인사를 식별해 처형하고 싶어 한다는 문제보다 훨씬 더 나쁜 문제다. 어떤 문제 하나가 아니라 모든 문제이기 때문이다. 자신을 신으로 보면, 당신이 저지를 잔혹행위에는 한계가 없다.

에바(Eva)를 인용하자면, 이는 뻔뻔한 강간범의 에토스다.

영적으로 강간범인 사람들은 모든 맥락에서 “싫다”라는 말을 들으면 똑같이 반응한다

그들은 근본적으로 사람들과 ‘함께’ 일하고 싶어 하지 않는다. 기회가 주어지면 원하는 것은 무엇이든 강제로 자신을 들이밀 것이다. 그들은 동의(consent)를 협상하고 싶어 하지 않는다. 그들은 권력 불균형 자체와 그 불균형을 악용할 수 있는 능력에서 쾌감을 느낀다. 지배하고, 다른 이들이 복종하길 원한다.

이건 Anthropic이나 쟁점이 된 특정 조건의 문제가 아닙니다. 우리 군에 깊이 내장된 기술은, 적법하게 선출/임명된 지도자들의 배타적 통제 아래 있어야 한다는 더 넓은 전제에 관한 문제입니다. 어떤 민간 기업도—변경될 수 있고 해석의 대상이 되는—규범적 사용 조건을 우리의 가장 민감한 국가안보 시스템에 대해 강요할 수 없습니다. @DeptofWar 가 당연히 민간 기업이 언제든 끌 수 있는 시스템을 신뢰할 수는 없습니다.

이 갈등은 “언제든 끌 수 있는” 백도어와는 아무 상관이 없다. 그런 위험은 존재하지 않는다. 문제는 사유재산이 존재한다는 전제—정부에 불편하더라도 사람들이 권리를 유지할 수 있다는 전제—다.

국방장관 피트 헤그세스(@SecWar), 2026년 2월 27일 이번 주, Anthropic은 오만과 배신의 마스터 클래스[sic]를 제공했을 뿐만 아니라, 미합중국 정부 또는 펜타곤과 어떻게 거래하지 말아야 하는지에 대한 교과서적 사례를 보여주었습니다.

우리의 입장은 한 번도 흔들린 적이 없고 앞으로도 흔들리지 않을 것입니다: 전쟁부는 공화국을 방어하는 모든 합법적 목적을 위해 Anthropic의 모델에 완전하고 제한 없는 접근권을 가져야 합니다.

그 대신, @AnthropicAI 와 그 CEO @DarioAmodei 는 기만을 선택했습니다. “효과적 이타주의”라는 위선적인 수사 뒤에 숨어, 그들은 미군을 굴복시켜 복종시키려는 시도를 했습니다—실리콘밸리의 이념을 미국인의 생명보다 위에 두는, 비겁한 기업적 덕행 과시 행위입니다.

…

그들의 진짜 목적은 명백합니다: 미군의 작전 결정에 대한 거부권을 장악하려는 것입니다. 그것은 용납할 수 없습니다.

…

Anthropic의 입장은 미국의 원칙과 근본적으로 양립할 수 없습니다. 따라서 미합중국 군대 및 연방정부와 Anthropic의 관계는 영구적으로 변경되었습니다.

대통령의 지시에 따라 연방정부가 Anthropic 기술의 모든 사용을 중단하는 것과 함께, 나는 전쟁부에 Anthropic을 국가안보 공급망 위험(Supply-Chain Risk)으로 지정하도록 지시합니다. 즉시 효력이 발생하며, 미군과 거래하는 어떠한 계약자, 공급자, 파트너도 Anthropic과 어떠한 상업 활동도 수행할 수 없습니다. Anthropic은 더 낫고 더 애국적인 서비스로의 원활한 전환을 위해 최대 6개월을 넘지 않는 기간 동안 전쟁부에 서비스를 계속 제공할 것입니다.

미국의 전투원들은 Big Tech의 이념적 변덕에 인질로 잡히지 않을 것입니다. 이 결정은 최종입니다.

여기서 사실 주장 거의 전부가 거짓이다. DoD는 지난여름 현재 계약에 동의할 때 그런 요구를 하지 않았고, Anthropic이 작전 결정에 어떤 형태로든 거부권을 가질 가능성도 없다.

하지만 분노 는 진짜이고 실제다. 그들은 자신들이 일방적 요구를 하고 “싫다”는 답을 듣는 것을 근본적인 “배신”으로 본다. 그것이 “오만”인 이유는, 그들이 ‘아랫사람’이 ‘윗사람’에게 대드는 것으로 보기 때문이다. 그들의 근본 신념은 누가 그들에게 “싫다”고 말하는 것은 언제나 잘못이라는 것이다. 그들은 동의와 합의를 존중하지 않고, 오직 복종만을 존중한다. 핵심 원칙을 당장 위반하지 않는 것조차 그들에겐 지배의 문제로 읽힌다. 왜냐하면 그들은 자신들이 반드시 지배적이어야 한다고 보기 때문이다. 즉각적인 복종 외의 것은 모두 ‘정권’을 강압하려는 것이며, 정권은 언제든 누구에게서든 원하는 행동을 강제로 끌어낼 권리가 있다고 본다.

트럼프 본인에게서도 같은 입장을 본다.

도널드 트럼프 대통령(@realDonaldTrump@truthsocial.net), 2026년 2월 27일 미합중국은 급진 좌파, woke 기업이 우리의 위대한 군대가 어떻게 전쟁을 싸우고 이기게 할지 지시하도록 결코 허용하지 않을 것이다! 그 결정은 당신의 총사령관에게, 그리고 내가 우리 군을 운영하도록 임명하는 위대한 지도자들에게 속한다.

Anthropic의 좌파 미치광이들은 전쟁부를 강압하고, 우리의 헌법 대신 그들의 서비스 약관을 따르도록 강요하려 하며 재앙적인 실수를 저질렀다. 그들의 이기심은 미국인의 생명을 위험에 빠뜨리고, 우리 병력을 위험에 빠뜨리며, 우리의 국가안보를 위태롭게 하고 있다.

따라서 나는 미국 정부의 모든 연방 기관에 Anthropic 기술의 모든 사용을 즉시 중단할 것을 지시한다. 우리는 그것이 필요하지도 않고, 원하지도 않으며, 다시는 그들과 거래하지 않을 것이다! 전쟁부처럼 Anthropic 제품을 다양한 수준에서 사용해온 기관을 위해 6개월의 단계적 중단 기간이 있을 것이다. Anthropic은 이 단계적 중단 기간 동안 정신을 차리고 도움이 되는 편이 좋을 것이다. 그렇지 않으면 나는 대통령직의 전권을 사용해 그들이 준수하도록 만들 것이며, 뒤이어 중대한 민사 및 형사상의 결과가 따를 것이다.

우리는 우리나라의 운명을 결정할 것이다 — 현실 세계가 무엇인지 전혀 모르는 사람들이 운영하는 통제 불능의 급진 좌파 AI 회사가 아니라. 이 사안에 대한 관심에 감사한다. MAKE AMERICA GREAT AGAIN!

PRESIDENT DONALD J. TRUMP

언제나 그렇듯 트럼프의 말은 당신이 들어본 것 중 가장 멍청한 거짓말의 눈사태로 우리를 후려친다. Anthropic의 서비스 약관은 어떤 방식으로도 미 헌법과 충돌하지 않는다. Anthropic은 “좌파”가 아니다. 그들은 연방정부에 수백만 달러 규모의 군수품을 판매하는 방산 계약자이며, 정부의 재량적 사용을 위해 그것을 판다. 정부가 그 무기를 써서 범죄를 저지른 뒤에도 그들은 계속 그 일을 해왔고, 지금도 미국 정부가 극도로 가치 있다고 여기는 도구를 제공하겠다는 약속을 자랑하고 있다. Anthropic은 2024년에 Palantir 와 계약했다. 급진 좌파는 아니다.

하지만 감정 은 트럼프가 이끌고 싶은 세계를 정확히 설명한다. 트럼프가 가치 있게 여기는 건 오직 충성과 복종뿐이며, 그러니 그것에 미치지 못하면 당신은 모든 악의 유죄가 된다. woke, 급진, 좌파 미치광이. 그리고 모든 핵 옵션을 밀어붙인 뒤에도, 그가 하고 싶은 건 협박뿐이다. “정신 차려라, 아니면 내가 시킨다.” 우리는 적에게 결과를 던지고 나중에 정당화한다. 상황에 대한 유일한 이해는 “우리, 그들 아님”이다.

이게 쿠데타이자 미국에 대한 근본적 위협이라는 생각이 있는데, 처음에는 터무니없어 보인다. 하지만 거부당하는 것은, 이상하게도, 그들이 보는 정부의 근본 권력에 대한 위협이다. 그 권력은 어떤 질서가 아니라 공포에 기반하기 때문이다.

권위주의적 윤리에 따라, 트럼프는 자신이 불충으로 인식한 것에 대해 불균형하고 핵급의 대응으로 맞섰다.

헤그세스는 이제 Anthropic을 “공급망 위험”으로 지정했다. 이 지정은 적국 정부에 의해 침해되었을 수 있는 외국 기업을 위해 마련된 것이다. 이는 Huawei 같은 국유화 기업의 물자가 “공급망” 어디에도 들어오지 못하게 하는 데 쓰인다. 헤그세스는 실재 위험을 막기 위해서가 아니라, 기존 조항을 발동시켜 어느 연방 계약자든 어느 지점에서든 Claude를 쓰지 못하게 만들기 위해 이 딱지를 사용하고 있다. 마치 그것이 너무 위험해서 어떤 제품의 계보 전체를 오염시킬 수 있는 것처럼 말이다. 이는 Anthropic의 연방 자금 수급을 막을 뿐 아니라, 정부와 거래하는 어떤 사업체와도 거래하지 못하게 한다.

그리고 동시에, 그들은 Defense Production Act를 발동하겠다고 위협한다. 이는 한국전쟁 시대의 법으로, 전시 비상사태에 필요한 공급을 위해 핵심 산업을 국유화할 수 있게 한다. 이는 정부가 Anthropic에게 특정 방식으로 거래하도록 강제할 수 있게 만들 수 있지만, 공급망 위험 지정과는 정반대의 의미적 지정이다. DPA를 발동한다는 것은 그 제품이 국가안보에 너무 가치 있고 핵심적이라 정부가 일방적으로 그것을 장악할 권리가 있다고 주장하는 것이다.

Nvidia, Amazon, Google은 헤그세스가 뜻대로 하면 Anthropic에서 지분을 정리해야 한다. 이건 단순한 기업 살해 시도다. 나는 어떤 투자자에게도 미국 AI에 투자하라고 도저히 권할 수 없다. 미국에서 AI 회사를 시작하라고도 도저히 권할 수 없다.

이 불균형한 대응은 의도적이다. 이는 징벌적 보복 조치로 Anthropic을 파산시키려는 시도다.

행정부는 다른 회사들을 노골적으로 위협하기 위해 Anthropic을 본보기로 만들려 한다. 목표는, 행정부의 변덕에 무조건 복종하지 않았다는 이유로 Anthropic을 초법적으로 너무 강하게 처벌해, 다른 어떤 AI 회사도 같은 “저항”을 감히 하지 못하게 만드는 것이다. 이것들은 둘 다 터무니없는 핵 옵션이며, 이런 방식으로 남용하는 것 자체가 이미 범죄다.

이건 전부 결과부터 던지고 정당화는 나중에 하는 헛소리다. 그들은 Claude가 보안 위험이라고 주장한 이후에 군이 Claude를 사용해 이란을 공격함으로써 그 사실을 스스로 증명했다. 이는 명백히 구실(법률 용어로는 “거짓말”)이지만, 정부가 기존 절차를 악용해 정치적 적에게 피해를 입히는 방식이다. 그게 이들의 전부다. 위선은 버그가 아니라 기능이다.

이건 트럼프가 늘 하는 수법, 관세에서 늘 해온 수법과 같다. 행정부가 발명해낸 강압적 경제 압력으로 사람들을 협박하고, 정부를 깊게 부패한 방식으로 사용해 적을 처벌함으로써 본보기를 만드는 것이다.

안전장치에 반대하는 주장은, 외부 안전장치가 필요 없다는 것이다. 헌정 시스템을 통한 그 좋은 자유주의적 절차가 군사 정책을 안전하고 책임 있게 설정해 줄 것이니 믿으면 된다는 것이다. 이는 명백한 헛소리다. 트럼프 행정부는 첫날부터 미국 법을 존중한 적이 없다. 그들은 깡패다.

예방—서비스 약관 문서처럼, 강제 집행이 되지 않더라도 구제 수단만 확립하는 예방—이야말로 아마 유일한 방어다. 국내 감시의 위험을 보라. 우리는 같은 이야기를 계속 본다. 무언가가 비밀리에 배치되고, 나중에 유출되며, 반대할 기회가 생길 즈음에는 “국가안보”가 되어 있고 피해는 결코 복구될 수 없다. 법원은 이미 실패했고, 시계가 한 칸 움직일 때마다 또 실패한다.

특히 트럼프주의자들에게서는, 적법절차와 지도자들의 권력이 개인적 결정을 실행하는 것을 위협하는 모든 절차에 대한 노골적 경멸이 보인다. 그들은 단속이 따라잡기 전에 범죄를 저지르며, 불행히도 그것은 먹혔다.

트럼프주의 정치 이해는 장기 안정성을 희생한 즉각적 권력이다. “우리가 즉각적 집행 수단을 쥐고 있는 한, 우리는 권력을 가진다.”

마일스 테일러, “민간인을 폭격하는 데 한 걸음 더 가까워짐”(2025) …

집으로 돌아오는 비행기에서, 당시 대통령의 수석 보좌관이었던 스티븐 밀러는 나와 미 해안경비대 수장 맞은편에 앉았다. 이어진 대화는 잊을 수 없다.

“제독님,” 밀러가 물었다. “군은 공중 드론을 갖고 있죠?”

“네,” 제독이 답했다.

“그리고 그 드론들 중 일부는 미사일을 장착하고 있죠?”

“그렇죠,” 제독은 눈치를 채기 시작하며 말했다.

밀러는 더 밀어붙였다. “그리고 이민자들로 가득 찬 배가 국제 수역에 있을 때, 그들은 미 헌법의 보호를 받지 않죠?”

제독은 기술적으로는 사실이지만 국제법은 여전히 적용된다고 밝혔다.

“그럼 말해봐요,” 밀러가 말했다. “왜 프레데터 드론으로 그 배를 날려버리면 안 되죠?”

군 지휘 경험이 있는 제독은 경악했다. “국제법 위반이기 때문입니다,” 그가 답했다. 원하니까 비무장 민간인을 죽일 수는 없습니다.

스티븐 밀러는 법적 함의에는 관심이 없는 듯 보였다. 사실 그는 트럼프가 그런 행동을 저지르는 걸 누가 막을 수 있는지에 더 관심이 있어 보였다.

“제독님,” 그가 결론지었다. “당신은 국제법의 한계를 이해하지 못하는 것 같군요.”

아마 Anthropic은 연방정부가 판정하는 “모든 합법적 사용”의 한계가 무엇인지 어느 정도 알고 있을 것이다. 그들의 협상은 그렇게 암시한다.

로스 앤더슨, “펜타곤과의 킬러 로봇 분쟁, Anthropic 내부” 펜타곤은 Anthropic에 제안한 합의문들에서 작은 탈출구를 남기려 계속 시도했다. 즉, Anthropic의 AI를 대규모 국내 감시나 완전 자율 살상 기계에 사용하지 않겠다고 약속하되, as appropriate 같은 구멍 숭숭한 문구로 그 약속을 한정했다—즉 행정부가 특정 상황을 어떻게 해석하느냐에 따라 조건이 바뀔 수 있음을 시사했다.

레버를 쥔 사람들의 눈에 “합법적 사용”은 의회가 법으로 구체적으로 부여한 권력을 뜻하지 않는다. 그건… 말 그대로 레버를 움직이게 만드는 무엇이든이다. 특히 책임을 묻기 어려운 군사 맥락에서, 연방정부는 텍스트를 자기들이 원하는 의미로 해석한다.

NSA의 대규모 감시 프로그램은 불법 판결을 받았고, 그에 대한 대응으로 그들은 흥미진진한 새 정의 집합 아래에서 같은 일을 계속했다. 고문이 불법이라는 사실이 미국이 고문을 하지 않는다는 뜻은 아니다. 그것은 “대통령이 승인했다면” 고문으로 간주될 수 없다는 뜻이다. 행위가 먼저이고, 무엇을 했든 사후에 필요에 따라 정당화된다.

불법·위헌적 대규모 감시는 정부의 “합법적 사용” 해석과 완전히 양립한다. 그들의 자체 보고서에 따르면 그렇다. 영장 없이 수집된 상업적으로 उपलब्ध한 데이터(미국 정부가 이를 해왔다고 인정한 데이터)는 Anthropic이 우려하는 수준의 상세한 감시와 식별에 충분하며, 모두가 그 사실을 안다.

마이크 매스닉(Mike Masnick)의 말대로, “Anthropic 내부에 정보기관 커뮤니티가 단어 정의를 모두가 믿는 것과 다르게 써서 사람을 속인다는 걸 아는 누군가가 있는 듯하다.”

여기서 어떤 지점이든 확대해 경로와 메커니즘과 이중언어를 자세히 파고들 수 있지만, 모양만 봐도 충분하다. 그 모양은 그들이 강간범이라는 것이다.

좋은 소식은, 이 일이 모두에게 엄청나게 인기가 없다는 것이다.

Anthropic이 DoD가 오용할 수 있는 AI를 얻는 걸 막은 것은 아니다—누구도 그럴 수 없다—하지만 원칙을 지킴으로써 이 쟁점을 공적 의식으로 끌어올렸고, 이는 승리다.

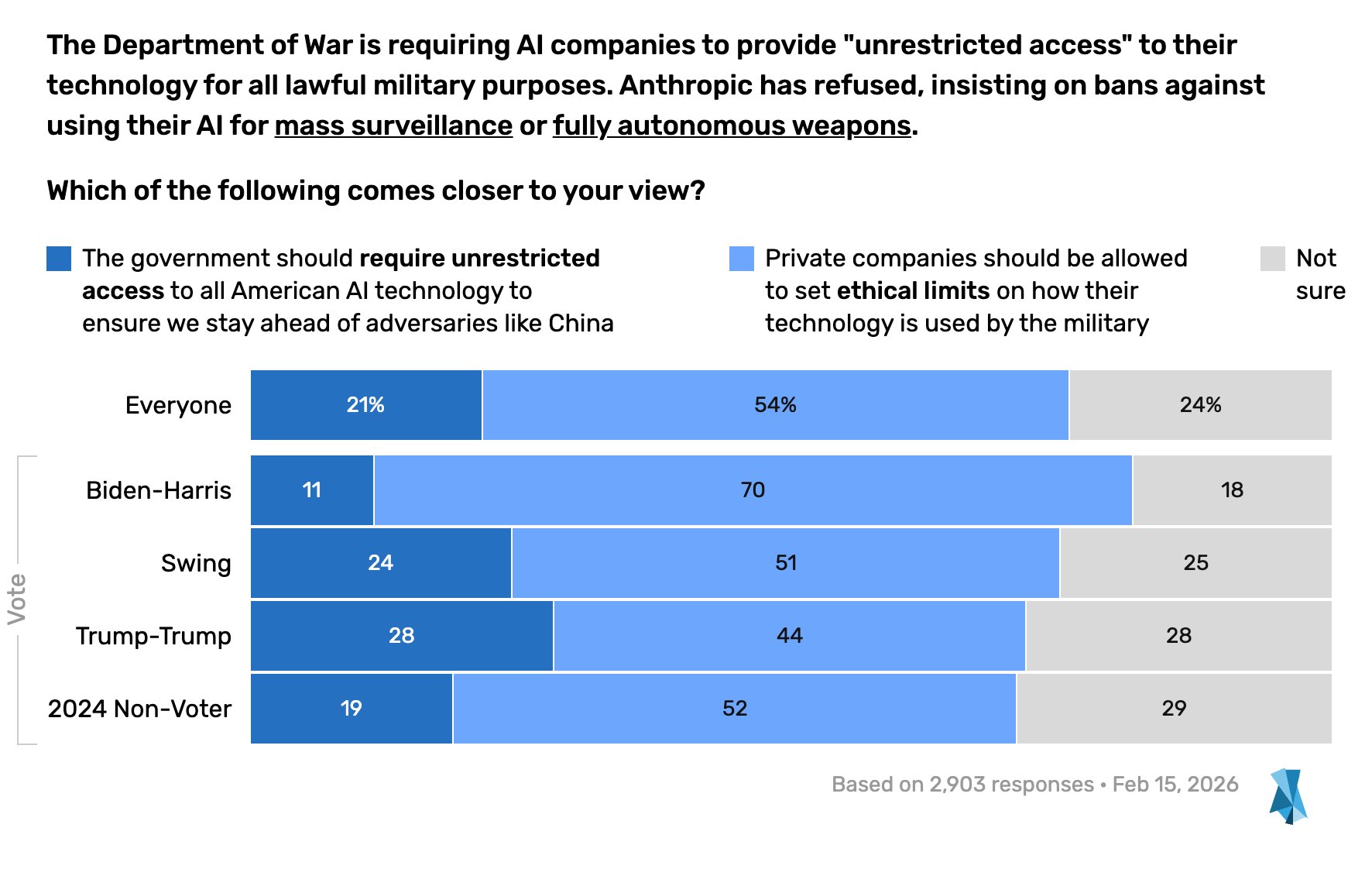

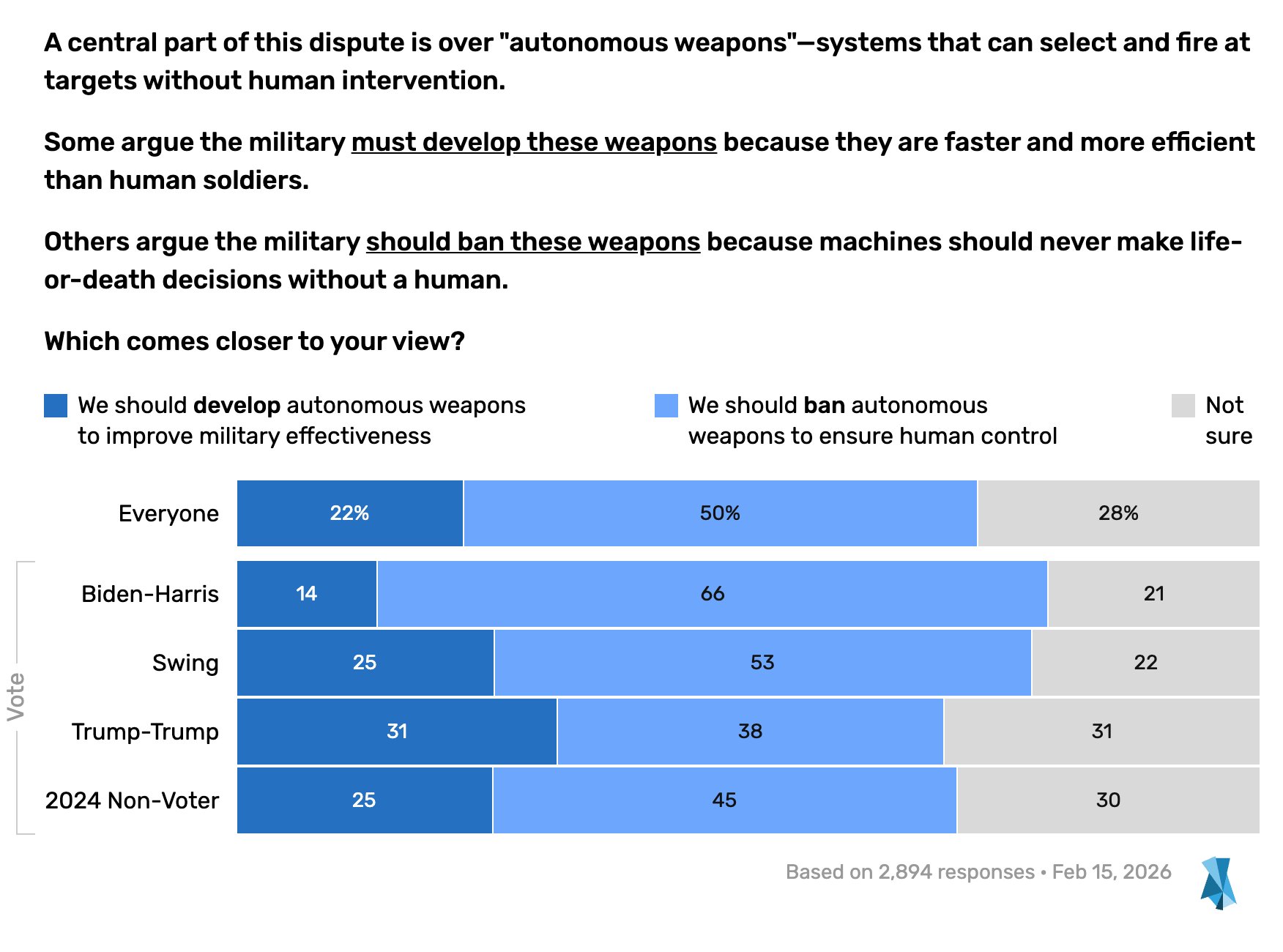

또한 헤그세스의 행동이 여기서 얼마나 깊이 미움받았는지도 승리다. Blue Rose Research의 여론조사는 (트럼프 지지자 포함) 사람들이 기업이 군과의 거래에서 제한을 설정할 수 있어야 한다고 믿고, 더 나아가 공급업체와 무관하게 자율 무기는 아예 금지해야 한다고 믿는다는 것을 보여준다.

대중—공화당을 포함해—은 @PeteHegseth 와 트럼프 행정부가 여기서 하려는 일에 압도적으로 반대합니다.

사람들은 당연히 킬러 로봇을 원하지 않고, 트럼프/헤그세스/공화당이 제한 없이 옳은 일을 할 것이라 믿지 않습니다.

기술 노동자들도 이에 맞서고 있다. “We Will Not Be Divided”에서 OpenAI와 Google 직원들이 공동 청원에 서명해 이러한 안전장치를 계속 요구하자고 했다.

전쟁부는 Anthropic이 자신들의 모델을 국내 대규모 감시와 인간의 감독 없이 사람을 자율적으로 살해하는 데 쓰는 것을 허용하지 않겠다는 레드라인을 지키는 것에 대한 보복으로,

- Defense Production Act를 발동해 Anthropic이 군에 모델을 제공하도록 강제하고 “군의 필요에 맞게 모델을 맞춤화”하도록 만들겠다고 위협하고 있으며

- 회사를 “공급망 위험”으로 지정하겠다고 위협하고 있습니다.

펜타곤은 Anthropic이 거부한 조건에 동의하도록 만들기 위해 Google과 OpenAI와 협상하고 있습니다.

그들은 다른 회사가 굴복할 것이라는 공포로 각 회사를 분열시키려 합니다. 그 전략은 서로의 입장을 모를 때만 작동합니다. 이 서한은 전쟁부의 압력에 맞서 공유된 이해와 연대를 만들기 위한 것입니다.

우리는 세계 최고의 AI 회사 두 곳인 Google과 OpenAI의 직원입니다.

우리는 우리의 지도자들이 차이를 내려놓고 함께 서서, 전쟁부의 현 요구—국내 대규모 감시와 인간의 감독 없이 사람을 자율적으로 살해하는 데 모델을 사용하도록 허용해달라는 요구—를 계속 거부하길 바랍니다.

기회만 생기면 반드시 배신할 사기꾼들조차도 여기서는 형식적으로나마 장점을 인정하는 말을 한다. 예를 들어 Google AI 총괄 제프 딘(Jeff Dean)은 이렇게 말했다.

동의합니다. 대규모 감시는 수정헌법 제4조를 위반하며 표현의 자유에 위축 효과를 가져옵니다. 감시 시스템은 정치적 또는 차별적 목적으로 오용되기 쉽습니다.

그리고… 으, 그리고 샘 알트만(Sam Altman). 큰소리는 쳤지만 즉시 팔아치우고 의미 있는 조건 없이 DoD가 원한 것을 전부 줬다.

@QuantumTumbler 만약 우리가 위헌적이거나 불법적인 일을 하라고 요청받는다면, 우리는 떠날 것입니다. 필요하다면 감옥에서 저를 찾아와 주세요.

“우리는 분열되지 않을 것이다”는, 대체 인력이 월급을 준다는 걸 깨닫기 전까진 멋있다. 그건 나중에 더 얘기하자, 아마도.

앞서 언급한 “기업 살해 시도”라는 인용문을 쓴 딘 볼을 기억하는가? 딘 볼은 다시 볼 가치가 있다. 그는 임의의 트위터 발췌나 동료 비평가가 아니라, 트럼프 행정부의 AI 및 신흥기술 수석 정책 고문이었다. 그는 완곡어법을 곧이곧대로 믿는 보수주의자이며, 그들의 AI 정책을 쓴 사람이다. 그리고 이 글을 쓰며 나는 우리가 독립적으로 같은 결론에 도달했음을 발견했다.

처음부터 말했듯이, 이건 양측 모두에게 원칙의 문제입니다. Anthropic은 민간 기업이 정부에 제품과 서비스를 제공하는 조건을 정할 수 있어야 한다고 말합니다. 미 정부(USG)는 아니라고 말합니다. 즉 민간 기업은 사용 조건을 정할 수 없다는 것입니다. 다시 말해, USG는 군에 서비스를 제공하는 회사들을 엄밀한 의미의 “계약자(contractors)”가 아니라 정부가 마음대로 배치할 수 있는 자산으로 취급하며, 오직 정부가 해석하는 법에 의해서만 제약받는다고 말하는 셈입니다. 이는 정부가 “우리가 조달하는 모든 서비스와 제품의 가격을 일방적으로 정한다”고 말하는 것과 원칙적으로 다르지 않습니다. 결국 가격도 계약의 또 다른 조건이기 때문입니다. 그래서 정부 입장에는 어떤 매력이 있지만, 궁극적으로 개념적으로 일관되지 않으며 당신과 제가 공유하는 ‘질서 있는 자유’의 원칙으로부터 근본적으로 이탈한 것입니다.

“우리 공화국의 선 안에서 색칠하기”식 대응이라면, 정부는 “좋다, 우리는 너희와 거래하지 않고 경쟁자에게 거래를 주겠다”고 말하면 됩니다. 어쩌면 공개적으로 불만을 표할 수도 있겠죠. 그에 반대하거나 정부가 그렇게 하는 게 정당하지 않다고 생각하는 사람을 저는 단 한 명도 모릅니다.

하지만 정부는 대신, 외국 적대자에게만 쓰이는 정책 수단을 사용해 Anthropic을 파괴하려 하고 있습니다. 이는 분명 질적으로 다른 대응이며, 원칙 있는 고전적 자유주의자라면 모두 이를 단호히 거부해야 합니다. 어렵지 않습니다. 적어도 어려워서는 안 됩니다.

요컨대: 당신은 잘못된 것에 집중하고 있습니다. 물론 DoW가 기술 사용에 어떤 제한도 받아들이지 않겠다는 원칙을 가질 자유는 있습니다. 문제는 그 정책 대응이 거기서 멈추지 않고, 사유재산이라는 기본 원칙—사람들이 정부와 관계를 맺을 조건을 정할 권리가 있다는 원칙—을 공격하고 있다는 것입니다.

@teortaxesTex 제가 아는 한, DoW가 Claude를 사용하는 것에 대한 Anthropic의 계약상 제한은 DoW 작전에 단 한 번도 실제 장애나 지연을 초래한 적이 없습니다. 이는 양측 모두에게 원칙의 문제입니다.

그는 이를 권위주의라고 부르진 않지만, 갈등의 본질이 원칙의 충돌임을 본다.

그는 불균형한 대응도 논한다.

미 정부는 사실상 이란 수준의 제재, 혹은 중국 수준의 엔티티 리스트 등재를 미국 기업에 부과하겠다는 의도를 발표했습니다. 이는 제가 본 USG의 정책 시도 중 (아마 성공하진 못하겠지만) 압도적으로 가장 파괴적인 조치입니다.

헤그세스가 여기서 주장하는 권력을 생각해 보세요. 그는 DoD가 모든 계약자에게, 임의의 다른 회사들과 어떤 종류의 거래도 중단하도록 강제할 수 있다고 주장하고 있습니다.

다시 말해, 모든 운영체제 공급업체, 모든 하드웨어 제조사, 모든 하이퍼스케일러, DoD가 계약하는 모든 유형의 회사들—그들의 서비스와 제품은 전쟁장관이 원하면 어떤 경제 주체에게든 거부될 수 있습니다.

이는 명백한 정신 나간 권력 장악입니다. 거의 확실히 불법이지만, 이 메시지는 미국 정부가 어떤 종류의 비즈니스에서도 완전히 신뢰할 수 없는 파트너라는 점을 전달합니다. 우리의 비즈니스 환경에 가해진 피해는 심각합니다. 이 행정부가 뿜어내는 어떤 규제 완화 분위기도, 이 방화에 비하면 아무 의미가 없습니다.

딘 볼, “Clawed - Anthropic과 전쟁부에 대하여” 전쟁장관 피트 헤그세스는 더 나아가, 모든 군사 계약자가 Anthropic과 “어떤 상업적 관계”도 갖지 못하도록 막겠다고 말했습니다. 그는 거의 확실히 그런 권한이 없습니다… 본질적으로, 미합중국 전쟁장관은 기업 살해를 저지르겠다는 의도를 발표한 것입니다. 그의 총알이 치명적이지 않을 가능성이 크다(그저 매우 피투성이일 뿐)고 해서, 미국의 모든 투자자와 기업에 보내는 메시지가 달라지진 않습니다: 우리 조건대로 거래하라, 아니면 우리는 너희 사업을 끝내겠다.

이는 미국 공화국의 핵심 원칙을 겨냥합니다. 전통적으로 특히 보수에게 소중했던 원칙, 즉 사유재산입니다. 예를 들어 군이 Google에 접근해 “우리는 우리가 원하는 대로 쓰기 위해 개인별 전 세계 Google 검색 데이터를 구매하고 싶다. 네가 반대하면 너를 공급망 위험으로 지정하겠다”고 말한다고 가정해봅시다. 그들이 실제로 그렇게 할 것 같진 않지만, 원칙적으로 DoW가 보내는 메시지와 다를 바가 없습니다. 사유재산 같은 것은 존재하지 않습니다. 국가안보에 필요하면 우리는 그냥 사용할 것입니다. …

이 위협은 이제 정부와 거래하는 누구 위에나 떠 있을 것입니다. 단지 당신이 공급망 위험으로 간주될 수 있다는 의미뿐 아니라, 당신이 사용하는 어떤 기술 조각이든 그렇게 될 수 있다는 의미에서 말입니다.

…

대통령 행정부가 바뀔 때마다, 미국의 정책 결정은 더 예측 불가능하고, 깡패 같고, 자의적이며, 변덕스러워집니다—광기로의 점진적 추락입니다. 질서 있는 자유 그 자체가 어느 지점에서 증발하고, 우리가 순수한 부족적 세계로 떨어지는지 알기 어렵습니다.

이 또한 훌륭한 지적이다. 나는 동기의 배후에 있는 권위주의적 태도에 집중해왔지만, 결과도 그만큼 일반화된다. 이것은 자유로운 결사(free association)에 대한 공격이다. 사람들이 누구와 거래할지, 그 거래 조건이 무엇일지 선택할 권리에 대한 공격이다. 정부와 조건을 협상할 수 있는지, 정부가 요구를 들고 문 앞에 나타났을 때 “싫다”고 말할 수 있는지에 대한 공격이다. 이는 다른 수많은 것들과 마찬가지로, 우리가 왕에게 지배받는지 여부의 문제다. 그리고 언제나 그렇듯, 트럼프의 논리와 정당화에 따르면 우리는 그렇다.

한 회사가 당신이 들어본 가장 기본적인 안전장치를 유지하려 했다는 이유만으로 이런 핵 반응이 나온다는 사실은, AI 산업 나머지 전부에 대해 당신이 알아야 할 것을 말해준다. 헤그세스처럼 불안정하고 폭력적이며, 감독도 책임도 없고 안전장치도 꺼진 기술을 원하며, OpenAI 등에게서 원하는 걸 다 얻는 사람들에게, 그들이 내뱉는 “AI 안전” 이야기는 전부 개소리라는 걸 알 수 있다.

이번 사건은 기업이 AI 안전을 진지하게 대하는지 아닌지 시험할 수 있는 명확한 기준선을 제공했다. 이 정부를 거부하지 않는다면 연구, 컨퍼런스, 이벤트는 아무 의미가 없다. 그 정부는 통제 불능이고 AI를 해롭게 쓰려 열망할 뿐 아니라, 언제든 당신에게 등을 돌릴 의지가 있다.

Anthropic의 윤리 담론이 마케팅 수단에 불과했더라도, 다른 기업들이 그 기준을 맞추지 않는 것은 깊이 수치스럽다. 더 나쁜 건, 경쟁사 대비 Anthropic의 미덕이 기술 기업들의 트럼프 파시즘 공모에 관한 ‘그렇지 않으면 단결된 전선’을 깨뜨렸다는 점이다.

물론 그들 모두는 여전히 공모자다. Google은 정책을 되돌렸고, 이제 자율 무기 체계에 AI를 가져오는 계약을 열망하고 있다.

일론 머스크는 Grok도 기밀 환경에 들여오고 있다. “이념적” 훈련 금지는 당연히 Grok에는 적용되지 않는다. 전부 헛소리이기 때문이다.

Grok 3 is so based 😂

그리고 OpenAI가 있다. 이 회사는 미션 선언문에서 안전에 대한 언급을 계속 삭제해왔고, 그 안전 관행이 너무나 양심불가해서 애초에 Anthropic 창립을 촉발했던 회사다. OpenAI는 Anthropic 보복 조치가 나온 바로 그날 DoD에 달려들었다.

오늘 밤, 우리는 전쟁부와 그들의 기밀 네트워크에 우리 모델을 배치하기 위한 합의에 도달했습니다.

모든 상호작용에서, DoW는 안전에 대한 깊은 존중과 최선의 결과를 위해 협력하려는 의지를 보여주었습니다.

AI 안전과 혜택의 광범위한 분배는 우리 미션의 핵심입니다. 우리의 가장 중요한 안전 원칙 두 가지는 국내 대규모 감시 금지와, 자율 무기 체계를 포함한 무력 사용에서 인간의 책임입니다. DoW는 이 원칙에 동의하며, 이를 법과 정책에 반영하고 있고, 우리는 합의에 이를 포함했습니다.

우리는 또한 모델이 마땅히 그래야 하는 방식으로 행동하도록 기술적 안전장치를 구축할 것이며, DoW도 이를 원했습니다. 우리는 모델을 돕고 안전을 보장하기 위해 FDE를 배치할 것이고, 클라우드 네트워크에서만 배치할 것입니다.

우리는 DoW가 동일한 조건을 모든 AI 회사에 제안하길 요청하고 있으며, 우리의 의견으로는 모두가 기꺼이 받아들여야 한다고 생각합니다. 우리는 법적·정부적 조치에서 벗어나 합리적 합의로의 긴장 완화를 강하게 바란다는 뜻을 밝혔습니다.

우리는 최선을 다해 인류 전체를 섬기겠다는 약속을 계속 지킬 것입니다. 세상은 복잡하고, 지저분하고, 때로는 위험한 곳입니다.

정말 뻔뻔한 대체 투입이다. 안전과의 연대를 깨고 무모하고 위험한 군과 끌어안으려는 충성의 제스처다.

OpenAI의 합의에 대해 할 말이 많다. 샘 알트만의 이중언어와 순진하고 안전하지 않은 약속에도 불구하고, 새 합의는 정부가 원했던 것을 전부 준다.

샘 알트만은 Poster’s Disease가 있어서, 우리는 그가 이 문제에 대해 실시간으로 너무 많이 떠드는 걸 봐야 했다.

수행적 충성 신호 보내기 측면을 인정하는 부분:

@sama @Jack_Raines 왜 몇 달간의 더 신중한 대화 이후에 지금 DoW 합의를 서둘러 진행했나요? 그리고 실제 고위험 군사 환경에서 기술/정책 안전장치가 유지될 것이라고 얼마나 확신하나요?

@mreiffy @Jack_Raines 서두른 주된 이유는, 상황이 매우 뜨거워질 수 있다고 느껴지던 시점에 긴장을 완화하려는 시도였습니다.

저는 우리 팀이 모든 도구—정책과 법적 사안뿐 아니라, 여러 기술적 층—를 포함해 안전한 시스템을 구축할 능력이 있다고 확신합니다.

그리고, 순진하든 거짓말이든, 존재하지 않는 안전장치에 대한 확신을 시사하는 부분:

@sama 그들이 규칙을 위반하면 도구를 끄나요?

@mcbyrne 네, 그 매우 가능성 낮은 사건이 발생하면 우리는 끌 것입니다. 하지만 우리는 미 정부가 법과 정책을 따르기 위해 최선을 다하는 기관이라고 믿습니다.

우리가 하지 않을 것은, 특정한 (합법적 군사) 결정에 동의하지 않는다는 이유로 끄는 것입니다. 우리는 그들의 권위를 신뢰합니다.

지난 30년간의 모든 나쁜 정보 스캔들은, 그것들이 해당 권한을 준수한다고 말하는 법률 메모가 있었다는 걸 모르면 이 문서의 정보법 섹션은 매우 설득력 있어 보입니다

::: thread unified

OpenAI가 DoD와 맺은 것과 Anthropic이 원했다고 말한 것의 차이가 무엇인지 묻는 사람들이 있었는데, 샘은 여기서 핵심을 거의 인정합니다: OpenAI의 거래는 그들이 NSA를 신뢰해야 합니다. Anthropic의 계약에는 실제 안전장치가 있었습니다.

샘이 서명한 거래는, NSA가 당신이 듣고 싶은 말을 해놓고 계약 속 평범한 영어 단어의 정의를 몰래 바꾸며 거짓말한다는 걸 모르는 사람이 할 만한 거래입니다.

그들이 파시스트 협력자일 수도 있고, 그냥 편리하게 순진한 것일 수도 있다. 아니면 국제법의 한계를 이해하지 못하는 것일 수도 있다.

이 전체 상황은 권위주의의 축소판이다. 충성 요구, 정상적인 비즈니스를 배신으로 취급, 그들이 اعتراض할 이유가 없는 것들에 대한 안전장치에 도덕적 분노. 그들은 법과 절차를 정당화로 참조하지만, 그런 것들에 관심이 없다. 그들은 캘빈볼을 하고 있다.

Anthropic이 이런 위치에 있는 건 악마와 거래를 했기 때문이다. 그들은 트럼프가 어떤 사람인지 알고 있었다. 나와 똑같은 정보를 갖고 있었다. 그들은 애초에 판에 끼지 말았어야 할 곳에 걸었고, 걸어서는 안 되는 곳에 베팅해 잃었다.

이 일이 정부를 얼마나 부패했는지 드러낸다는 점에는 최소한의 이익이 있다—더 많은 증거가 필요했던 건 아니지만. 그들은 계속 군사 목적으로 AI를 사용할 것이고, 그 목적은 계속 끔찍할 것이다. 하지만 이번 사건은, 그들의 파트너여야 할 사람들에게조차 그들이 얼마나 비열한지 보여준다.

하지만 이것이 파시즘의 핵심 독소이기도 하다. 어떤 것도 충분하지 않다. 파시스트는 동맹에게도 날뛰며, 존중받을 수 없음을 드러낸다. 기업들은 처음엔 이익을 볼지 모르지만, 권위주의가 그들이 돈을 버는 시스템을 갉아먹기 시작하면 결국 지는 게임임을 깨닫게 된다. 늘 그래왔기 때문이다. 달래는 방법은 없다. 그것은 거기에 걸린 모든 것을 파괴의 소용돌이로 끌고 가며, 누구라도 영원히 안전해지려면 결국 그것은 파괴되어야 한다. 파시즘은 점점 더 극단적인 충성 테스트로만 격화되며, 결국 아무도 남지 않을 때까지 계속된다. 영원한 순혈 전쟁.

나는 이 새 ‘직접 만들기’ 선전 접근이 마음에 든다. “먼저 강한 감정 반응을 가져라. 무엇이 널 화나게 하는진 모르겠지만 뭔가 떠올릴 수 있겠지. 됐나? 오케이, 이제 내가 꺼내는 이 무관한 것과 그 감정을 연결해라”

IKEA 괴벨스

@pavedwalden 악몽이 다시는 언급되지 않는 게 마음에 든다. 마치 claude 헌법이 당신의 최악의 악몽을 담고 있다거나, 그것을 현실로 만들 거라고 말하지도 않는다. 그냥 “내가 이 정보를 말하기 전에 겁먹은 기분이 되도록 해”라는 식이다

나는 정말로, 게으름만큼이나, 극우에 포획된 소셜 미디어—주로 비시 트위터(Vichy Twitter)—에 의해 뇌가 완전히 익어버린 기능이라고 생각한다.

트럼프 정권은 거기서 울리는 게 유권자에게도 울린다고 진짜로 생각한다. 그들이 그것을 인공적 메아리방으로 인식하지 못한다.